はじめに

この「あったらいいなシリーズ」は、HAL独自の目線で具体的な身体的制約について取り上げ、その制約に対してこんなものが世の中にあったらいいのになと想像・提案する不定期更新のシリーズです。どなたかの何かのヒントになるよう、既に世に出ているソリューションのご紹介も交えて執筆していきます。

注意:本記事は、色覚異常を持つ当事者の社内メンバーの意見や知識をもとに、編集部にて一部調査した内容を記載しております。すべての内容について医学的根拠等を検証していない点のみご理解ください。また、HALが提案するソリューションについてはアイディアベースであり、具体的な医学的根拠や推奨などはございません。また、イラストの無断使用・転載やデザインの流用など著作権法の違反になる行為はおやめください。その他についてのお問合わせはこちらからご連絡をお願いいたします。

言語障害とは

文部科学省の定義では、言語障害とは、発音が不明瞭であったり、話し言葉のリズムがスムーズでなかったりするため、話し言葉によるコミュニケーションが円滑に進まない状況であること、また、そのため本人が引け目を感じるなど社会生活上不都合な状態であることを指します。

また、発声発語器官(唇、顎、舌、鼻からのど、気管・気管支から肺までつながる声を出すための器官)のどこかに異常が起こったために正しい発音ができなくなる「構音障害」と、大脳にある言語領域に異常が起こったために言葉を使うことができなくなる「失語症」の2つに分けられます。

構音障害

構音障害の症状としては、「声が出ない」「声はでるが、はっきりと発音できない」「特定の音(特にタ行・ラ行またはバ行・パ行)が出ない」「舌がもつれる」「ろれつが回らない」などがあります。通常、構語障害のみの場合には、字を書いてコミュニケーションをとることは可能とされています。

失語症

失語症の症状は「言葉が出ない」「言い間違いが多い」「滑らかに言葉は出るものの、その場に適切な言葉が選べない」「意味不明な言葉を話す」などの「話す」障害や、「音は聞こえるが、話しかけられた内容が理解できない」といった「聞く」障害、「文字が読めない・書けない」「文字は読めても内容は理解できない」などの「読む・書く」障害など多岐にわたります。これらはすべて失語症の症状として知られています。

【引用元】

文部科学省サイト「(6)言語障害」

健康長寿ネット「言語障害」

音声入力を補助するソリューション

人間拡張技術で解決できるのか

前述の通り、言語障害と一口に言っても多様な原因と症状があり、個人差が大きく関係しているのが分かります。それらを全て同じテクノロジーを用いたソリューションで解決するのは、極めて困難なことと言えるでしょう。しかしながら、高精度な実験結果を有する言語障害へのソリューションがいくつか開発・発表されているのでご紹介します。

Googleアプリ「Project Relate」

この新アプリは、「脳卒中」「ALS」「脳性麻痺」「外傷性脳損傷」「パーキンソン病」など、発話に影響を与える発話障害を持つ人々が、より簡単に他者とコミュニケーションを取るために、Google アシスタントとやり取りできるようにすることを目的としています。Google社のSpeechチームとResearchチームが長年研究し続けているもので、Google の研究活動の参加者によって記録された100 万を超える音声サンプルによって可能になりました。数カ国内で英語を話すテスターを探しており、アプリを試してもらったフィードバックをアプリ改善に役立てているとのこと。

Project Relate の早期テスターとして、一連のフレーズを録音するよう求められます。アプリはこれらのフレーズを使用して、ユーザー固有の発話パターンをよりよく理解する方法を自動的に学習し、アプリの 3 つの主な機能であるリッスン、リピート、アシスタントにアクセスできるようにします。

【リッスン】

聞く機能により、Relate アプリはあなたのスピーチをリアルタイムでテキストに変換するため、テキストをコピーして他のアプリに貼り付けたり、伝えたいことを他者に読んでもらうことができます。

【リピート】

リピート機能を使用すると、明瞭な合成音声を使用して、話した内容を言い直すことができます。この機能は、特に、対面での会話やホーム アシスタント デバイスに対してコマンドを話す場合に、役立つことを期待されています。

【アシスタント】

Relate アプリ内から Google アシスタントに直接話しかけるので、照明をつけたり、曲を再生したりするなど、さまざまなタスクを簡単に処理できます。

100万人以上を対象に試験できるのはGoogle社ならではであり、様々な可能性に期待が高まる研究ですね。また、実際に対象の障害を持つ人材が自ら被験し、研究に携わっていることも、現実的かつUI/UXに沿った本当に利用できるソリューションを生むことに必須の条件だと考えます。言語の性質的に日本語対応は難しそうな所見です。

【参照・引用元】

「A communication tool for people with speech impairments」Google The Keyword

東京大学、米ジョージア工科大学などが開発「SilentSpeller」

東京大学、米ジョージア工科大学などによる研究チームが開発した「SilentSpeller」は、口パク(無声発話)で1文字ずつタイピングするハンズフリーの入力システムを提案しています。

歩きながらでも入力が行える安定性を持ち、スマートフォンのQWERTY文字入力に匹敵するほどの十分なタイピング速度を兼ね備えているとのこと。1文字ずつのスペル入力により、これまでの単語ベースで認識する無声発話入力よりも認識可能な語彙が大幅に増加したと話しています。

音声入力だと、公共の場で使用する場合、プライバシーの侵害の恐れがあり、パスワードやアドレスのような機密情報を扱うこともできません。そこで音声を使わずに無声発話によってハンズフリーの文字入力を行う「サイレント・スピーチ・インタラクション」が注目されています。

Silent Spellerは無声発話の課題をクリアし、歯科用リテーナー型デバイスをユーザーに口でくわえてもらう方法でスペル認識を行います。度重なる実験結果では、1164語の単語テストにおいて平均97%の精度を示し、また座りながらの入力で96.5%の平均認識精度に対し、歩きながらの入力で97.5%とほぼ同程度の数値が出たことで、歩行の影響はほとんどないことが確認されました。また、走行中の電車内の騒音環境でも機能することもわかっています。

口の中に入れることにハードルがあるデバイスですが、無声発話でこれだけの精度が出せれば実用化への期待が膨らみます。麻痺症状を持つ場合も利用できるのか、その感度や精度にも注目です。

【参照・引用元】

「1文字ずつ口パクでスペル入力できるシステム、東大などが技術開発 タイピング速度はスマホに匹敵」ITmedia

暦本純一教授「DualVoice」

ソニーコンピュータサイエンス研究所(CSL)フェロー・副所長であり東京大学大学院情報学環の暦本純一教授が開発した「DualVoice」は、キーボードやマウスなどを使用せず、音声入力だけで長い文章が書けるソリューションです。文字入力以外のコマンド入力と音声認識ミスによる修正は、通常の声とは別に「ささやき声」で操作。通常の声とささやき声を使い分ける方法で、ハンズフリーの完全な音声入力を実現するというがポイントです。例えば「改行」という指示と発言したい言葉が同じ場合、言葉としての入力は通常の声、指示はささやき声で行うことで入力が可能になります。

音声入力が前提のソリューションですが、暦本氏はこれに加えて口パクの「無声発話」の研究にも取り組んでいるので、更なる展開に注目したいです。

【参照・引用元】

「音声だけで完全な長文が書ける技術、東大教授が開発 ささやき声で“改行”や“修正”などコマンドを入力」ITmedia

HALが考える「あったらいいな」

ご紹介した通り、かなり具体的に実用化に向かっているソリューションが目立ってきています。他にも喉の振動から信号を受け取るセンサーや、通常の布マスクにセンサーをつけた無声発話(口パク)を行うソリューションなどもありました。デバイスのみで機能するタイプと、アプリなどを経由して機能するタイプにざっくり分かれています。前者は、特に日常で使用することに抵抗がなるべく生じない使用感・デザインであることも考慮する必要があります。

今回もHALが提案する「あったらいいな」をご紹介します。

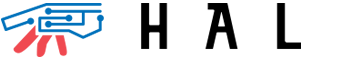

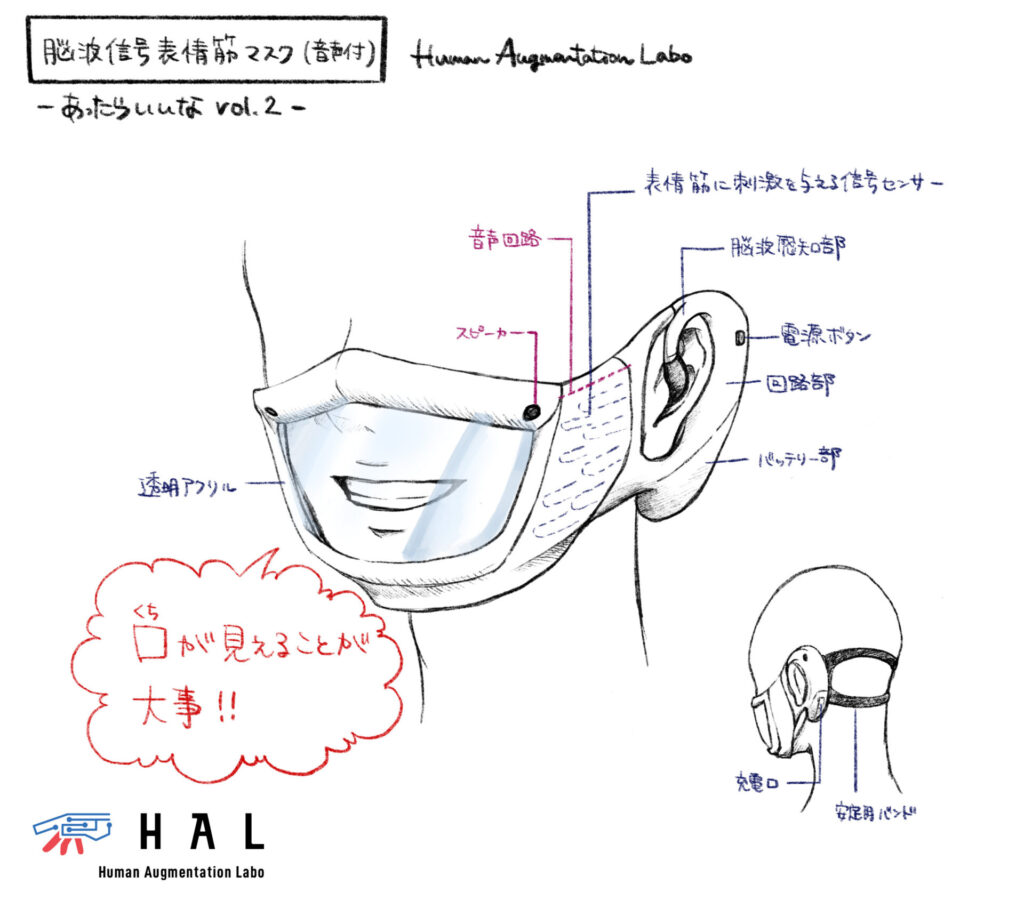

脳波で考えたことをキャッチし、センサーによって表情筋に刺激を与えて口元を動かす脳波信号表情筋マスクです。脳波をキャッチするテクノロジーは、以前HALでもご紹介したCyberneX社のXHOLOSのイメージしています。

受け取った脳波を表情筋に信号を送るセンサーに伝達します。小さなスピーカーから脳波から受け取った音声が出せると、表情と合わさり、より自然なコミュニケーションができそうです。脳波を利用すれば、失語症へのアプローチも期待したいところです。

マスクの表面は透明にすることが大事なポイントだと考えています。口の中にセンサーを入れる無声発話テクノロジーやProject Relateも、組み合わせると様々なシーンに対応できるソリューションが生まれそうですね。今後も注目したい分野です。